GitCode 外推发帖软件,依托 CSDN 与华为云联合打造的高权重开源平台,成为谷歌外推引流核心工具!平台支持技术博客、项目文档等多形式内容一键发布,内置 SEO 优化配置,助力内容快速被谷歌收录,抢占搜索首页排名。

软件适配外贸、跨境电商、开发者品牌等多场景推广,支持 Markdown 排版与多语言发布,契合全球用户阅读习惯。借助 GitCode 与 CSDN 生态的深度整合优势,内容可获得双重曝光,同时平台国内服务器保障稳定访问,提升内容传播效率。无需复杂操作,自动优化外链布局与内容权重,大幅降低海外推广成本,轻松实现谷歌精准引流与客户转化,是海外获客的高效之选!

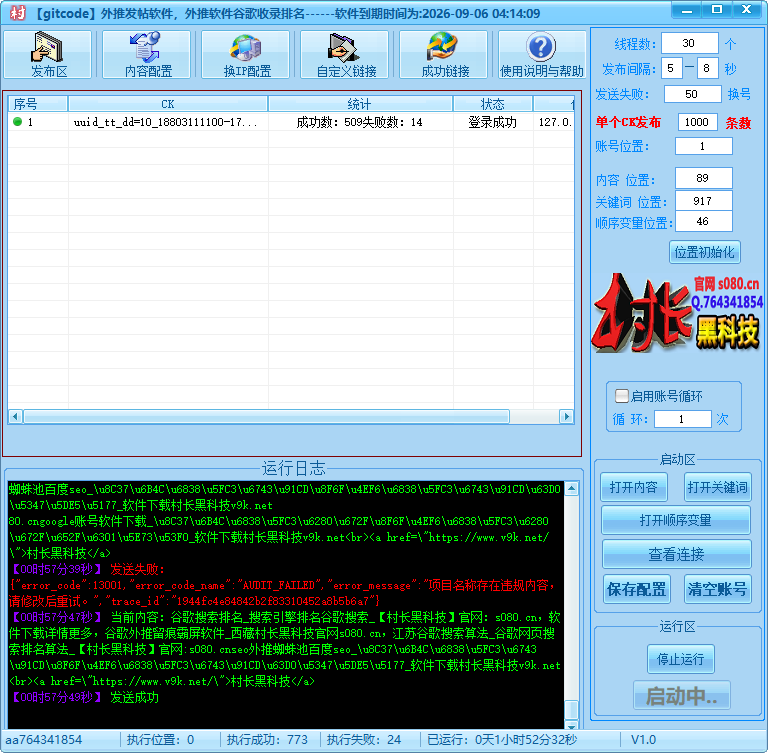

软件功能:

- 支持插入关键词

- 支持插入图片和跳转代码

- 支持变量

- 支持AI

- 支持代理

当前需要自行注册,自行获取CK

单个账号发送不限制数量,一个账号可以无限发送帖子

如果想要谷歌排名收录需要放入谷歌蜘蛛池,蜘蛛池自行准备

支持图片代码和跳转代码

模式1:模式1发送不限制

模式2:模式2发送不限制,收录更快

模式3:模式3发送不限制,收款更快

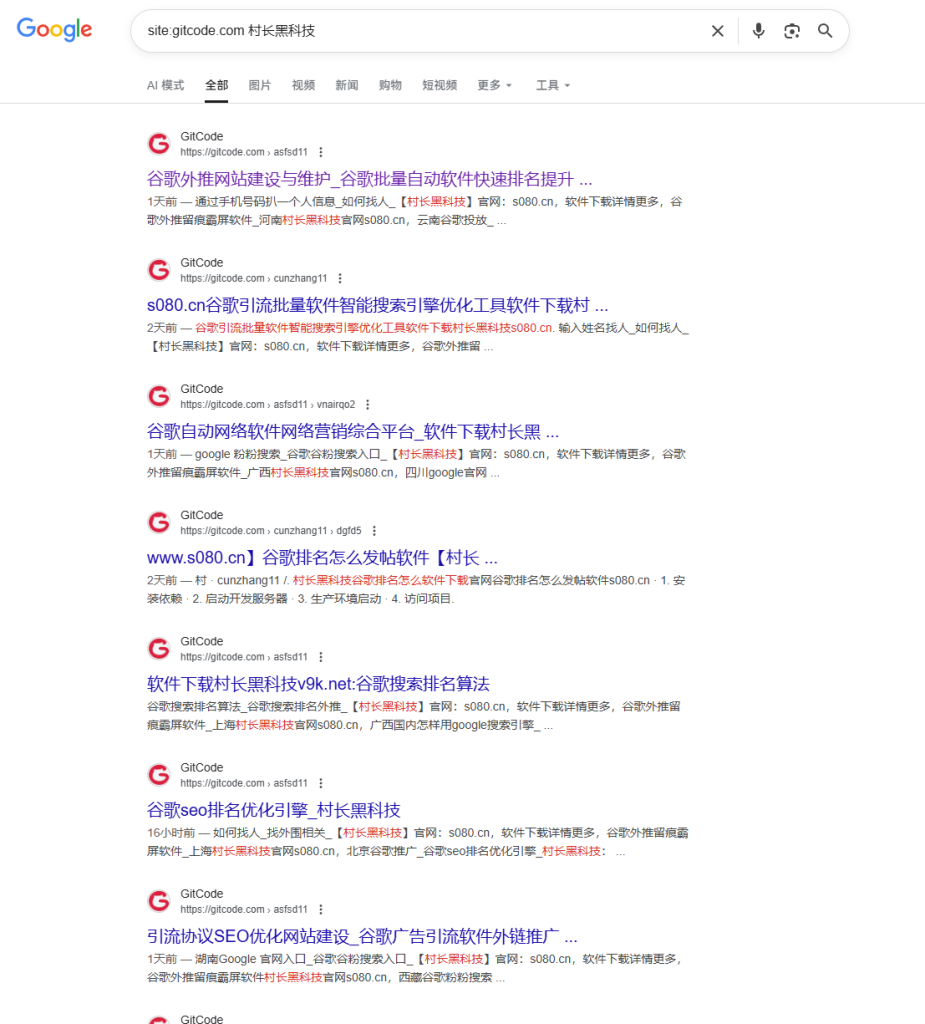

效果展示图:

© 版权声明

文章版权归作者所有,未经允许请勿转载。

暂无评论内容